ためになる3Dグラフィックスの歴史(6)。AI技術の進化にGPGPUがもてはやされる背景

https://pc.watch.impress.co.jp/docs/column/zenji/1493893.html

※ 「なぜ、AIの実装に、GPUが用いられるようになったのか」の背景の一端が語られている…。

※ 長年の疑問が、ある程度解消した…。

※ 『マシンラーニング型AIの形成過程(≒学習過程)、そしてそのAIを活用過程(≒推論過程)において、この畳み込み演算を、大量に行なうことになる。

畳み込み演算は、実務的には「行列同士の掛け算」なので、この計算はGPUが内包する膨大な「プログラマブルシェーダ実行ユニット」(つまりはシェーダプログラム実行ユニット)でそのまま演算可能なのだ。

すなわち、GPUをGPGPU的に活用すれば、膨大なデータ量の畳み込み演算が高速に行なえるわけで、だからこそ、AI技術開発にGPUが引っ張りだことなったわけである。』…、という部分がキモか…。

※ 『ただ、GPUは、もともと3Dグラフィックスを描画するためのプロセッサだ。畳み込み演算専用機として利用するには、シェーダプログラム実行ユニットには、テクスチャユニットを始めとしたグラフィックス描画支援機能がたくさん接続されている。

NVIDIAは、「GPGPU業界の方々がそこまで熱望するならば」……ということで、シェーダプログラム実行ユニットから余計な機能をバッサリとカットした畳み込み演算実行専用ユニットを、2017年発表のVolta世代のGPU「GV100」から搭載した。

Quadro GV100

そう、それが言わずと知れた「Tensorコア」である。実は「推論アクセラレータ」の異名を持つTensorコアだが、実際に行なえるのは畳み込み演算(行列の乗算)だけ。

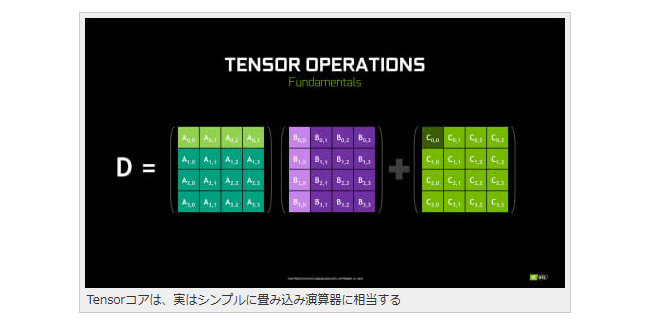

Tensorコアは、実はシンプルに畳み込み演算器に相当する』…。

※ 内部回路的には、ここがキモか…。かつ、NVIDIA一強となったキモでも、あるのか…。

『 トライゼット西川 善司 2023年4月17日 06:05

2022年3月、NVIDIAはその当時で世界最高性能のGPU「GH100」を発表。GPGPU専用として提供された。3Dグラフィックスを処理できないわけではないが、基本的にはGPGPUでの利用が想定されたプロセッサである。GPGPUセンセーションは、現在進行形で産業を席巻しつつある

前回は、熟成を極めたDirectX 11と、「別バージョンのDirectX 11」として誕生したDirectX 12を紹介した。そしてこのDirectX 12がDirectX 11と併存することになった経緯、DirectX 12が誕生した時勢などについても解説しつつ、最後は近代GPUの基本技術基盤である「プログラマブルシェーダ」技術が進化していった結果、新概念「GPGPU」技術が誕生したことにも触れた。

今回は、現在このGPGPU技術が、GPUにとって「3Dグラフィックス描画」に優るとも劣らぬほどに「重要なGPUの活用先」となってきている状況について深掘りしていきたい。

実は、昨今の「人工知能ブーム」や「自動運転技術の発展」は、このGPGPUという概念が誕生しなければ、ここまで急速に進歩しなかったかもしれないと言われている。

「ゲームの映像を描画すること」が主な仕事だったGPUが、どのようにして人工知能や自動運転といった技術開発に関係していったのか、その流れを振り返っていくことにしよう。

今回は、かなり話が方々へと脱線していくが、このシリーズのまとめということで、あらかじめご了承いただきたい(笑)。

GPGPUが巻き起こしたマシンラーニング型AIのビックバン現象

その筋の研究者達が、GPGPU技術をマシンラーニング(機械学習)型AIの実現に応用し始めたのは、2010年前後くらいからだとされる。

そして、昨今のAIブームの直接のきっかけは、2012年に起きた「ある象徴的な事件」ではないか、とも言われている。

スタンフォード大学が2010年より立ち上げた大規模な画像データベースに「ImageNet」というものがあり、当時約1,400万枚におよぶ膨大な画像データベースから課題として抽出された約50万枚の画像を学習し、その学習を完了したAIに対して約2万枚の試験画像を見せ、「これがなんであるか」を推論させる画像認識AIの競技「ImageNet Large Scale Visual Recognition Challenge」(ILSVRC)が毎年行なわれていた。

ちなみに、この競技自体は2017年が最後の開催となっている。

この「AIの画像認識力の優劣を競う競技」の2012年大会において、トロント大学のAlex Krizhevsky氏らが、GeForce GTX 580×2基構成のGPGPUマシン(要は2GPU構成のPC)で、平均的な人間の正解率を超える結果をはじき出して優勝した。

なお、優勝したマシンラーニング型AIの実装手法についてまとめた論文は「ImageNet Classification with Deep Convolutional Neural Networks」としてまとめられている。

NVIDIAのCEO、ジェンスン・フアン氏も、後年この2012年の出来事を「マシンラーニング型AIの世界にビッグバンが起きた」と語っている。

この事件以降、マシンラーニング型AIはKrizhevsky氏が行なった実装手法に倣うようになり、進化と発展が一気に加速する。

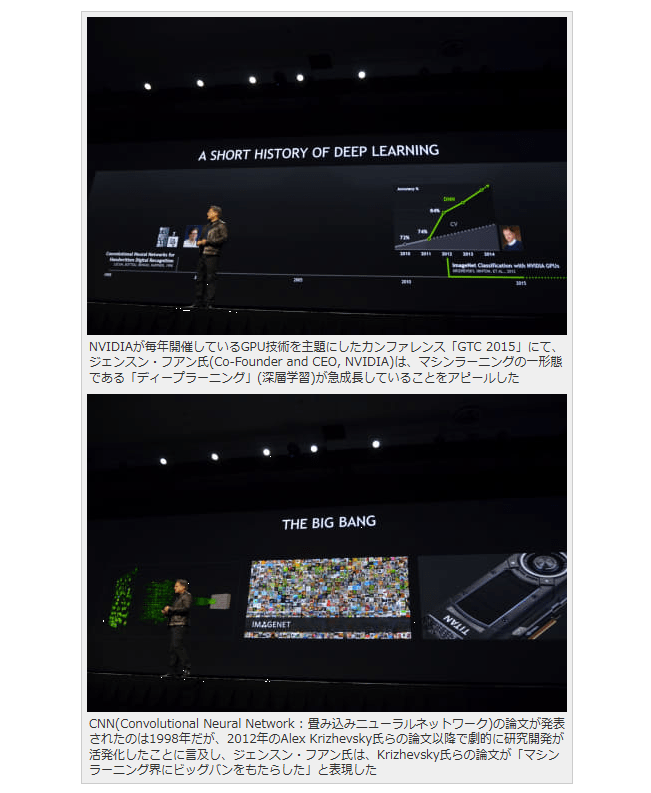

NVIDIAが毎年開催しているGPU技術を主題にしたカンファレンス「GTC 2015」にて、ジェンスン・フアン氏(Co-Founder and CEO, NVIDIA)は、マシンラーニングの一形態である「ディープラーニング」(深層学習)が急成長していることをアピールした

CNN(Convolutional Neural Network : 畳み込みニューラルネットワーク)の論文が発表されたのは1998年だが、2012年のAlex Krizhevsky氏らの論文以降で劇的に研究開発が活発化したことに言及し、ジェンスン・フアン氏は、Krizhevsky氏らの論文が「マシンラーニング界にビッグバンをもたらした」と表現した

また、2014年にはスタンフォード大学のAndrej Karpathy氏らが、画像を見せると流暢な英語でその画像の内容を解説する作文生成タイプのマシンラーニング型AIを発表した。これはまさに、昨今大ブームになっている対話型AIの源流に相当する研究だと言える。

AIに鳥が写っている画像を入力すると、単に主題としての「鳥」だけを認識するのではなく、その画像中に描かれているすべてのオブジェクトを認識して、各オブジェクトの関係性を解釈して「鳥が木の枝に止まっています」と作文にまとめることができるAIが発表されたのだ。この論文は以下の動画で紹介されている。

スタンフォード大学のAndrej Karpathy氏らの論文「Automated Image Captioning with ConvNets and Recurrent Nets」からの抜粋。写真を見せられた学習型AIがかなり的確な英作文を披露する事例。学習した知識にないものが示されると間違えることもある。「赤ちゃんの例」はそのささやかな誤り例。

人間に拮抗する人工知性がビジネスになる予感は10年前から?

ChatGPTに代表される、言語処理系AIの「凄み」は、実は今から10年以上前からその片鱗が現れていた。

2011年、アメリカのTVクイズ番組「Jeopardy!」の全米チャンピオン大会に、IBMの研究グループが開発したマシンラーニング型AI「Watson」を出場させたところ、人間の挑戦者達を抑えて優勝したことがある。

アメリカのTVクイズ番組「Jeopardy!」の全米チャンピオン大会にIBM製のAI「Watson」が挑戦した

とは言っても、当時出題された問題のAIへの入力は、音声認識経由ではなく、人間の手入力によるものだった。そのため、対等な対決ではなかったようだが、「AIが人間にクイズで勝つ」という事象は大きな驚きとして受け止められた。

この「Watson」を開発したIBMの研究グループのリーダーRob High氏(IBM Fellow,VP,CTO)によれば、2010年代の人間は1日あたり2.5エクサバイト(2,500,000テラバイト)のデータをネットワーク上のストレージ上に出力しており、これが2020年代には1日あたり44ゼタバイト(44,000,000,000テラバイト)に突入すると予測している。

また、High氏は、そうなったときに膨大なデータから人間の興味のある事柄を抽出したり、そこから分析を進めたり、あるいはそれらを組み合わせて新たなるコンテンツを創出したりするための手助けをしてくれる存在として、マシンラーニング型AIエージェントはいずれ不可欠な存在となるだろうと述べていた。

2020年代の今は、まさにそんな状況になりつつある。

IBMのAI「Watson」研究開発グループのリーダーRob High氏(IBM Fellow,VP,CTO)は「今(発言時は2016年)から10年以内に、ネットワーク上を往来するデータのすべてをAIが認知を取得して学習するサーバーシステムが運用される時代が来るはずだ」と予見した

こうした「AIに支援を受けるコンピューティングパラダイム」をIBMでは「COGNITIVE COMPUTING」と命名し、2013年に新しいジャンルのクラウドサービスとして事業化している(日本でのサービス開始は2016年から)。

現在直近のWatsonの応用事例は、IBMのWatson活用事例のページにまとめられている。

IBM自身も斬新な料理レシピを生成する「シェフ・ワトソン」などを稼動させ、話題を呼んだ。また、Watsonを幼児向けの知育玩具に応用した「CogniToys」などもリリースされた。

幼児の「なんで?」に応対できる能力を持つ知育玩具「CogniToys」シリーズ。登場時は話題にはなったが、シリーズが継続するほどの人気商品とならなかったようだ(笑)

ゲーム画面を見てプレイするゲームAIの誕生

2015年にはGoogle系の英国ベンチャーのDeepMind社が開発したAIに、クラシックなゲーム機「Atari 2600」のブロック崩し、インベーダーなど、全49種のゲームをルールを教えずにプレイさせ、以前のプレイよりもスコアが高かったら「そのプレイは良いプレイだった」という評価を与え、反復的にプレイさせて学習させたところ(いわゆる強化学習モデル)、半数以上のゲームにおいて人間のトッププレイヤーの腕前を上回った成果を報告した。

DeepMind社が開発した「ゲーム画面を見てプレイするAI」の成長過程をまとめた動画。「どうすれば得点が稼げるか」を何百回という試行の繰り返しの過程で学習していく様が見て取れる

同じAIを「スペースインベーダー」で訓練させた事例。学習を終えたAIは、敵の弾を巧みに避け、飛来する高得点のUFOも確実に迎撃する

2016年には、このDeepMindの開発したAI「AlphaGo」が、人類最強の囲碁プレイヤーとも言われる韓国人のイ・セドル九段を4勝1敗の戦績で打ち破ったニュースが世界を駆け巡った。

ちなみに、このAlphaGoは、前出のAtari 2600をプレイしたAIと仕組み的には同じで、AlphaGoは基本的には囲碁のルールを知らないという事実も、業界に大きな衝撃を与えた。

実は、AlphaGoは過去の膨大な上級者同士の対戦の棋譜の流れを「白石を白ピクセル」「黒石を黒ピクセル」とした「白黒画像の遷移データ」として学習し、最終局面において「これが勝ち」「これが負け」という「流れの筋」を学習して構築されたAIだった。

なので、囲碁というゲームのルールそのものを深く理解はしていない。セドル九段が唯一勝利を収めた第4局は、中盤でAlphaGoが学習した膨大な過去の棋譜にないと推測される“奇手”を打ったことが勝因につながったと分析されている。

囲碁の基本ルールすら知らなかったAlphaGoの弱点を突いてセドル九段は勝利したというわけである。SF漫画みたいな話でちょっとカッコイイ逸話である。

日本におけるマシンラーニング型AIのゲームへの導入事例

日本においても、コンピュータゲームに対するAIの導入の研究は盛んだ。

2019年に開催されたCEATEC 2019において、バンダイナムコは縦スクロールシューティングゲームの名作「ゼビウス」をプレイするAIロボを発表した。

このAIは、前出のDeepMindが開発したゲームプレイAIとほぼ同方針の「教師なしAI」×「強化学習型AI」として開発されたものになる。

つまり、AIはゲームのルールを一切教えられていない赤子状態でゼビウスをプレイさせられ「良い行動」をしたら「えらいぞ」と褒美を与えて訓練を繰り返し、開発されたものになる。

学習にあたっては「実際のゲーム画面の15fps単位の画像」(一部処理しやすいように画像を低解像度化+鮮鋭化)を入力情報とし、「ゲーム画面に反応したレバー/ボタン操作」を出力情報としていた。

「Q56」(きゅうごろう)と名付けられたゼビウスAIプレイヤーロボ。実際の頭脳はこの白い展示台の下に隠されたデスクトップPC。Q56がアケコンを操作しているように見えるが、実はアケコン側の方が動いていて、Q56の腕の方が動かされている仕組み。ただ、展示中のゲーム画面が推論エンジンに入力され、リアルタイムにレバー/ボタン操作を出力しているので、AIデモとしてインチキはない

開発最初期の報酬授与条件は「高得点」だったが結果が振るわず。しかし開発後期「生存時間」に改めたところ、プレイが急激に洗練されたとのこと。ただ、あまりにも上手すぎても展示としておもしろみがないため、ブースではときどき失敗する学習レベルの低いAIをあえてお披露目したとしている。ちなみに、自機が死ぬとこちらに顔を向けて困った顔をする

我々がPCやゲーム機で普段プレイしているようなコンピュータゲームに対しても、マシンラーニング型AIの導入の研究は行なわれている。

特に興味深いのは、対人戦を想定したバトルAIの研究で、それらのAIは我々人間が実際に対人戦をプレイするように「その時点での戦局(ゲーム状況)」を理解した上で、AIが的確に方向レバー入力とボタン操作を行なわせて戦うものである。

まず、先陣を切って商品化にまで漕ぎ着けたのがSNKだ。同社が2019年に発売した「サムライスピリッツ」(以下、サムスピ)で、そのAIプレイヤーが実装されている。

SNKの公式サイトに掲載されているサムスピのゴーストモードの紹介

サムスピでは、プレイヤーという存在をシンプルな入出力演算器として考えているのが興味深い。

具体的には、プレイヤーについて「1フレーム単位のゲーム状況」を入力情報として与えてやると、「レバー操作とボタン押し」を出力する演算器と見なすのである。

なお、AIが出力する「レバー操作とボタン押し」は、あくまで「そういう操作をした」と見なされるゲーム操作データになる。物理的に実在するコントローラのレバーやボタンをロボットハンドが操作するわけではない。

ここで言う「ゲーム状況」とは具体的には、闘い合う2体の両キャラ位置とモーション状態、両者のゲージ状態、残り時間、現ラウンド数(ラウンド取得状況)などを指す。

サムスピでは、人間がサムスピを遊んだ際の「1フレーム単位のゲーム状況」とそのプレイヤーの「レバー操作とボタン押し」をマシンラーニングさせることで、そのプレイヤーのプレイスタイルを模倣するAI(ゲーム内ではゴーストと呼称)を構築する機能を搭載したのだ。

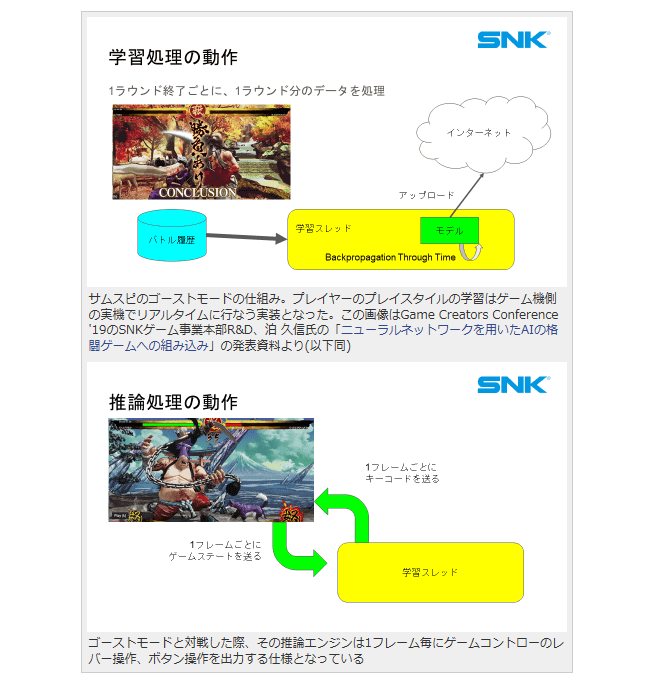

サムスピのゴーストモードの仕組み。プレイヤーのプレイスタイルの学習はゲーム機側の実機でリアルタイムに行なう実装となった。この画像はGame Creators Conference ’19のSNKゲーム事業本部R&D、泊 久信氏の「ニューラルネットワークを用いたAIの格闘ゲームへの組み込み」の発表資料より(以下同)

ゴーストモードと対戦した際、その推論エンジンは1フレーム毎にゲームコントローのレバー操作、ボタン操作を出力する仕様となっている

同年、2019年に開催されたCEDEC 2019では、スクウェア・エニックス傘下の株式会社Luminous Productionsに所属する上段達弘氏が、3DバトルゲームのプレイヤーAIを、サムスピのゴーストAIに近いアプローチで制作した事例を発表している。

黒服キャラが敵AI、白服キャラがプレイヤーAI。ともにゲームコントローラを操作してキャラクタを動かしているというのがとても興味深い

AI技術の開発になぜGPGPUが有効なのか

前出のAlphaGoでは、公開されている過去の膨大な数の世界トッププレイヤー同士の対戦棋譜を「畳み込みニューラルネットワーク」(CNN)に入力してマシンラーニングさせ、これを言わば「基礎知識」として持ち、この同じ基礎知識を持ったAI同士で対戦させて、勝敗が付いたら勝った方のゲームの進め方を「良棋譜」として学習結果に加えることで「腕前の強化」が行なわれていった。

CNNは画像認識AIによく使われるニューラルネットワークで、入力した画像の特徴を抽出することに向いている。

たとえば、膨大な「猫」の画像をCNN入力して、その学習結果として猫の特徴を取得すれば、撮りたてほやほやの新たな「猫」写真についても、このCNNはこれを猫として判断できるようになる(実際には入力画像が猫である確率を算出する)。

CNNの模式図例。512×512ピクセルの入力画像を256×256ブロックで畳み込み演算を行ない、その結果をさらに128×128ブロックで畳み込み演算を行なう。これを繰り返していくことで、入力画像ジャンルごとの特徴データが得られる。この特徴データの分類集積が実質的な学習ということになる。CNN基礎理論の発案は1970年代に行なわれていたが、演算量が膨大であったことから近年になってやっと実用レベルの技術に進化した

CNN以外のニューラルネットワークには、たとえば回帰性ニューラルネットワーク(RNN : Recurrent Neural Network)と呼ばれるものもある。このRNNは、当初、音声や文章のような1次元データを取り扱うのに有効だとされていた。

たとえば英語で「I」(私)のあとに続く単語として「am」や「was」が来る確率が高いことが見込まれるが、もし「I」の前に「When」があったとすると「When I」となるので「am」ではなく「was」へ続く可能性がグッと高まる。

このように、データ同士の相関性を学習して動作するAIがRNN型AIである。言語の解読や翻訳、作文といった用途には、RNNが適しているとされる(現在はほかの手法が活用される傾向にあり)。

さて、そもそもこのニューラルネットワークとは何なのか。

和訳すれば「神経回路網」となるが、機能だけに着目して簡潔に説明すれば「複数要素からなるデータを入力してやると何らかの結果を返す関数」のようなものだ。

これまでにさまざまな形態のニューラルネットワークが考案されているが、その多くの根幹演算には畳み込み演算(Convolution)が用いられる。

畳み込み演算とは、与えられた2つの数列(データ)の要素同士を全組み合わせで乗算して加算し合わせる演算のことだ。

ギターなどの楽器音に残響を与えるエフェクター装置などは、この畳み込み演算をもっともシンプルに活用した音響機器である。

数列X「3,5,-7」と数列H「12,-4」に対する畳み込み演算。数列Yに結果が収められるまでの演算過程

マシンラーニング型AIの形成過程(≒学習過程)、そしてそのAIを活用過程(≒推論過程)において、この畳み込み演算を、大量に行なうことになる。

畳み込み演算は、実務的には「行列同士の掛け算」なので、この計算はGPUが内包する膨大な「プログラマブルシェーダ実行ユニット」(つまりはシェーダプログラム実行ユニット)でそのまま演算可能なのだ。

すなわち、GPUをGPGPU的に活用すれば、膨大なデータ量の畳み込み演算が高速に行なえるわけで、だからこそ、AI技術開発にGPUが引っ張りだことなったわけである。

ただ、GPUは、もともと3Dグラフィックスを描画するためのプロセッサだ。畳み込み演算専用機として利用するには、シェーダプログラム実行ユニットには、テクスチャユニットを始めとしたグラフィックス描画支援機能がたくさん接続されている。

NVIDIAは、「GPGPU業界の方々がそこまで熱望するならば」……ということで、シェーダプログラム実行ユニットから余計な機能をバッサリとカットした畳み込み演算実行専用ユニットを、2017年発表のVolta世代のGPU「GV100」から搭載した。

Quadro GV100

そう、それが言わずと知れた「Tensorコア」である。実は「推論アクセラレータ」の異名を持つTensorコアだが、実際に行なえるのは畳み込み演算(行列の乗算)だけ。

Tensorコアは、実はシンプルに畳み込み演算器に相当する

Tensorコアは、1基あたり、最大4×4要素の行列同士の乗算が1クロックで行なえる。具体的には、下図のような64回の乗算と48回の和算を1クロックで行なうことができる。

Tensorコアの1クロックあたりの演算実務を展開するこんな感じ。人間が筆算するには拷問レベルで面倒臭い

普通のシェーダプログラム実行ユニットでは、1要素(1データ)が最大32bit浮動小数点(FP32)演算に対応しているが、Tensorコアはここは割り切っており、最大16bit浮動小数点(FP16)までと制限している。

AI技術開発用途では、精度的にはFP16で必要十分過ぎるくらいであり、AIが取り扱う学習テーマによっては8bit以下でも十分とされることも多い。よって、最近のNVIDIA GPUのTensorコアでは8bit整数(Int8)、4bit整数(Int4)、1bit(バイナリ)にまで対応する。

そうそう、最近のスマートフォン製品においては「AIチップ搭載!」というような触れ込みが目立つようになってきている。

AIチップ搭載という魅惑のキーワードに痺れて、つい「オレのスマホちゃんは人工知能搭載だぜ、すげえぜ」と自慢したくなることがあるが、実はそのAIチップとは、ここまでで解説してきた「シンプルな行列演算器の塊」にしか過ぎない。

いずれにせよ、高尚なAIも最小演算単位が畳み込み演算(行列の乗算)から成り立ってるということを考えると、我々の知性も根源自体はシンプルな演算の賜なのかもしれない……と思わされてなんとも感慨深い。

広がりを見せるマシンラーニング型AIの応用先

さて、2012年以降、センセーショナルな発展を見せたマシンラーニング型AIのすべてにおいて、NVIDIAのGPUがGPGPU的に利用されていた。

この事実は、前回紹介した「2010年の世界最速スパコンTOP10のうちの3台がNVIDIAのGPUベースだった」という事象に並ぶほど、NVIDIAにとって「GPGPUに対する強風の追い風」となったことは言うまでもない。

マシンラーニング型AIは、ごくごく簡単にたとえれば「膨大なデータ同士の相関性を計算し、これを学習データにする」「AI利用時には、入力データとその学習データの相関を求めて、その度合いに応じた推論を導く」……というような処理系となっている。

この仕組みは、画像の認識、インベーダーゲームをプレイするAI、囲碁をプレイするAIなどなど、あらゆる分野への応用が利く。

そう、2012年以降、GPGPUベースとなったマシンラーニング型AIは「どんな分野で有効か」の探索フェーズに入り、まさに各産業分野において高効率かつ高精度なAI開発が急ピッチで進められている状況となっていった。

たとえば音声データを取り扱った音声認識や、膨大な言語の文書データを取り扱った翻訳への応用はすでに実用レベルに達している。

意外なところではディズニーやピクサーなどのCGアニメーション映画制作会社が、キャラクターに魅力的な動きを付けるのに、モーションキャプチャではなく、マシンラーニング型AIを応用する研究を始めている。

日本では、塩野義製薬が新薬試薬の臨床試験解析にマシンラーニング型AIの導入を開始したことを発表しているし、レントゲン写真やMRI像から疾患の有無を判断するエキスパートシステムに、マシンラーニング型AIを導入しようとする研究も進められている。

そして、リアルタイムに周囲の情景(映像)を認識して最良の行動を判断するだけでなく、過去の学習データから、今の情景から未来に起こりうる危険なことを確率的に予測できるマシンラーニング型AIもありふれた存在となりつつある。そう、自動車の自動運転向けAIなどはその最たる事例だと言えよう。

2017年5月にNVIDIAが開催したGTC 2017の基調講演にて、トヨタ自動車は自社の自動運転技術開発に、NVIDIAのGPUを搭載したSoCを採用することを発表した

マシンラーニング型AIは、学習データ次第で今見えている状況から、この先で起こりうる未来が確率論的に予測できるところが、従来のセンサーからのリアルタイム情報に基づいてアルゴリズムでリアクション的に意志決定するAIとの大きな違い。ドアが閉まっている車があったとき、過去に「突然ドアが開いて、そのドアに衝突したことがある。これは良くないこと」という学習があれば、同じ状況時に警戒ができる。リアルタイムにリアクションするだけでなく、起こりうることを予測して警戒できるAIは、自動運転技術の意志決定には非常に都合が良い

GPGPUの世界でも激化が進むGPUメーカー同士の戦い

近年では「NVIDIAは妙にGPGPUに注力している」などと言われることがあるが、むしろ「GPGPUを積極活用している業界の方が金に糸目を付けない勢いで高性能GPUを欲している」状況になっており、今やグラフィックス業界に優るとも劣らぬほどのGPU市場の上客になりつつある。

そんなわけで、企業体であるNVIDIAの行動方針に「GPGPUユーザー重視」の傾向が見られるようになったとしても不思議なことではない。

冒頭で紹介したGH100のような「GPGPU専用のGPU製品をグラフィックス描画向けよりも先行してリリースする」という状況は、こうした背景があるからなのだ。

さて、なぜここまでGPGPUの世界がNVIDIA一強になってしまったのだろうか。これにはいくつかの理由が考えられる。

Radeonブランドを有し、プログラマブルシェーダ技術の進化に大きく貢献したはずのATIは、大手CPUメーカーのAMDに2006年に買収されている。

AMDはCPUメーカーでもあるため、HPC(High Performance Computing : 学術界や産業界が欲する科学技術計算用の超高性能な計算処理系。端的に言えばスパコン)業界にCPUを訴求したいという思惑を捨てきれず、GPGPUの方向へ大きく傾倒した戦略をとることができなかった……と筆者は考えている。

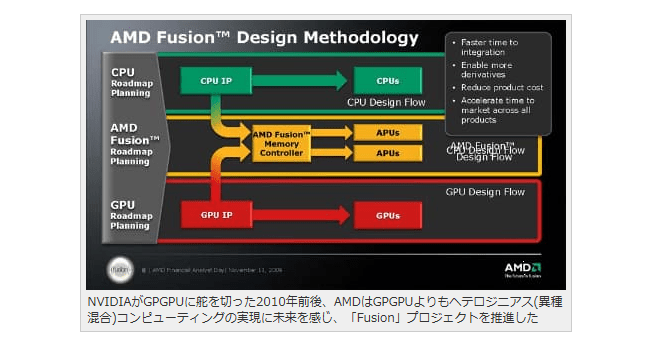

さらに、AMDは「そうしたHPC分野には、CPUとGPUを統合させた新構造のプロセッサが適しているはず」という姿を見出していた。

この着想を元にした新プロセッサは当初「Fusion」というプロジェクトネームで発表されたのち、実際の製品としてはAPU(Accelerated Processing Units)シリーズで展開された。

またAMDは、次世代APUシリーズに向けて、CPU管理下のメモリ空間とGPU管理下のメモリ空間を論理的に共有一体化させたGPGPUプラットフォームとして、HSA(Heterogeneous System Architecture)を提唱。

NVIDIAがGPGPUに舵を切った2010年前後、AMDはGPGPUよりもヘテロジニアス(異種混合)コンピューティングの実現に未来を感じ、「Fusion」プロジェクトを推進した

この流れは非常に有効そうに見えたのだが、初期のAPUはどちらかと言えばエントリークラスからミドルクラスの性能を持った、一般ユーザー向けの普及価格帯PC向けソリューションとして訴求されていため、HPC業界に振り向いてもらえなかった。。

歯に衣着せずに言うと、最初期のAPUはCPU性能もGPU性能もHPCが求めるパフォーマンスに達していなかった……ということである。

このタイミングで、若干時代の流れを読み間違えたAMD(ATI)は、GPGPU向け戦略(≒近代HPC戦略)においては相応の遅れをとってしまった感がある。

ATI買収をきっかけにしてAPU開発に傾倒し、GPGPU環境整備に遅れをとったAMDだったが、このAPUプロジェクトそのものは一定の成功を収めているということだけは付け加えておこう。

そう、PS4、PS5、Xbox One、Xbox Series Xなどの近年の家庭用ゲーム機のメインプロセッサは、すべてAMDのAPUであり、言わばFusionプロジェクトの間接的な産物なのであった。

近年の家庭用ゲーム機の多くは、AMDのAPUを使用している

さて、AMDは、この「遅れ」を取り戻すべく、2015年前後あたりからGPGPU環境整備ヘの取り組みを積極的に行なうようになり、2016年にAMD独自のプラットフォーム「ROCm」(Radeon Open Compute Platform)の推進を開始した。

NVIDIAのCUDA戦略に対抗すべく、GPGPU(≒GPU COMPUTING)環境整備に力を入れ始めたAMDは、ROCmを推進中

以降、堅実的な開発と環境整備を続けたことで(まだまだNVIDIAのCUDAプラットフォームほどではないが)、徐々にHPCの世界で存在感を強めつつはある。

近年では、AMDのRyzen CPUと、同社のGPGPU専用GPU製品であるRadeon Instinctの組み合わせで構成されたスパコンが、米国のオークリッジ国立研究所(ORNL)と米国エネルギー省(DoE)に採用されたことが大きく報じられた。

米エネルギー省、世界最速の新スパコンにAMD製CPU/GPUを採用

GPUの覇権争いは、今後GPGPUの世界でも続くと見て間違いない。

「ためになる3Dグラフィックスの歴史」シリーズのまとめ

もともとこのシリーズは、編集部から「なぜNVIDIAとAMD、Intelといった異なる半導体メーカーが作るGPUで、同じようなゲームグラフィックスが出せるのでしょうか?」というお題が起点となっていた。

全6回の間、だいぶ脱線することも多かったが、GPUというプロセッサの活用のされ方がここ20年くらいで、まるっきり変貌してしまったので、それも致し方がないといったところ。

今回のシリーズは、本稿でひとまずの終わりとなる。最後に、全6回のまとめを年表的な箇条書きで示し、元々のお題に対する回答のようなものを示そうかと思う。

【1】1990年代初期。もっとも身近なリアルタイム3Dグラフィックスはゲームセンターのゲーム機に存在した。

1993年に登場した「バーチャファイター」

【2】1990年代中期。PCでリアルタイム3Dグラフィックスを実現する気運が高まるが、それを担当する3Dグラフィックスハードウェアとその制御APIが乱立した。DirectX(Direct3D、以下同)は登場当時は求心力が低かった。

初代Voodooを搭載した3Dグラフィックスハードウェア。当時はDirectXの影は薄く、これを動かすには3dfx社独自のAPI「Glide」を用いる必要があった

【3】1990年代後期。DirectX7登場とともに、それまでCPUが担当していたジオメトリ演算系までをも、3Dグラフィックスハードウェアが担当可能になる。「GPU」というキーワードの誕生を機に、いくつかあった3DグラフィックスAPIにおいても淘汰が開始され、DirectXの立場が向上する。

1997年に登場した「バーチャロン」。IntelのSIMD拡張命令であるMMX技術が使われた

【4】2000年代初期。GPUの機能拡張(≒3Dグラフィックスにおける新表現の実装)をソフトウェアの形で行なっていく枠組み「プログラマブルシェーダ技術」が誕生する。これにいち早く対応したDirectX 8がこの技術の進化を牽引していく流れに。

DirectX 8世代のGPUから採用された「プログラマブルシェーダアーキテクチャ」。写真はその対応GPU「GeForce3」

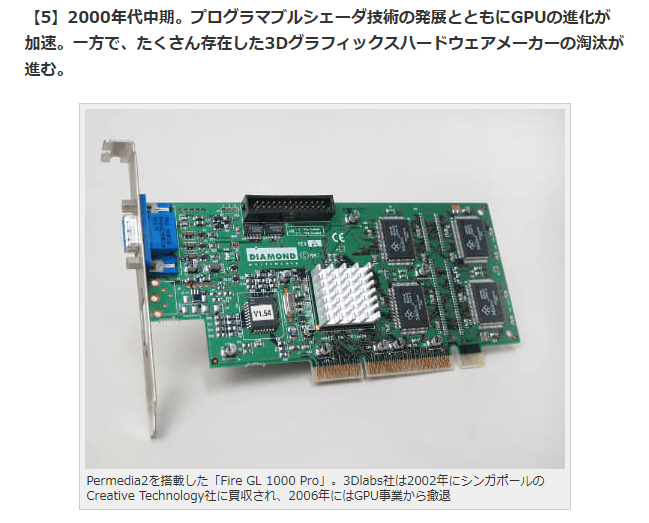

【5】2000年代中期。プログラマブルシェーダ技術の発展とともにGPUの進化が加速。一方で、たくさん存在した3Dグラフィックスハードウェアメーカーの淘汰が進む。

Permedia2を搭載した「Fire GL 1000 Pro」。3Dlabs社は2002年にシンガポールのCreative Technology社に買収され、2006年にはGPU事業から撤退

【6】2000年代後期。NVIDIA GeForce対ATI(AMD) Radeonの闘いが激化。この闘いが追い風となってGPUはより高性能化。プログラマブルシェーダ技術のプログラマビリティが一層強化。DirectXもDirectX 11まで進化する。

「GeForce FX 5900 Ultra」と「RADEON X1800 XT」

【7】2010年代初期。高まったGPUのプログラマビリティがGPGPU技術を育み、実用化へと進む。任天堂、ソニー、Microsoftの三大家庭用ゲーム機はすべてプログラマブルシェーダ技術ベースへ。対応最後発は2012年発売の任天堂のWii U。ちなみに、もっとも早く対応したのは2001年発売の初代Xbox。2番手は2006年発売のPS3。

2001年に発売された初代「Xbox」は、世界初のプログラマブルシェーダ技術採用の家庭用ゲーム機

【8】2010年代中期。GPGPUがマシンラーニング型AIの開発に大きく貢献。GPU制御APIの抽象レイヤーを薄型化する流れが発祥した結果、DirectX 12とVulkanが台頭する。ただし、旧来APIのDirectX 11とOpenGLも併存することに。

Vulkanの前身となった「Mantle」。AMDが2013年に発表

【9】2010年代後期。GPGPU技術の加速度的な進化で、自動車の自動運転技術開発を始め、GPGPUとAIが切っても切れない関係性へ。GPGPU市場が大規模化する。また、このタイミングでGPUにリアルタイムレイトレーシング機能が搭載される(本シリーズでは未フォロー)。

世界初のGPGPU対応GPU「GeForce 8800 GTX」。発表は2006年

こんな感じになるだろうか。

「なぜ、NVIDIAとAMD、Intelといった異なる半導体メーカーが作るGPUで、同じようなゲームグラフィックスが出せるのでしょうか?」という問いに対しては、

「プログラマブルシェーダ技術」の規格化によって、3Dグラフィックス表現がソフトウェアの形で行なえるようになり、広範囲な互換性が担保されるようになったから

……ということになろうか。

プログラミング言語的な方言、APIのパラメータの与え方の違い、座標系の違い……といった細かな差異はあれど、同じプログラミングモデルで制作されているため、ほとんどの近代3Dゲームグラフィックスは異機種間に対する相互移植が可能となっている。

また、昨今の発展著しい先進のゲームエンジン技術の台頭により、そうした相互移植性まで面倒を見てくれるようにもなってきている。

ただ、今でもGPUごとに、プログラマブルシェーダ技術の実行時の結果に、微細な結果が出ることはある。

なぜそうしたことが起こりうるのかについては、本シリーズの2回目や3回目で紹介した「緑のたぬきと赤いきつね」の闘いのあたりで触れたエピソードのようなことが、未だに細かい部分で残っているからである。

なお、今回のシリーズでは、レイトレーシング技術に付いては一切触れなかったが、これはまだ進化の途中であり、この後の進化の方向性が定まっていないためだ。また時間が経ったときに、このあたりの話題はお届けすることにしたい。

それではまた。 』

英トラス前首相の悔恨 「知らなかった」財政のリスク

加藤晶也

https://www.nikkei.com/article/DGXZQOUA110NV0R10C23A4000000/

※ 財政出動は困難…、となれば、残りは「金融政策」のみとなる…。

※ それで、「非伝統的緩和政策(異次元緩和、とも言う)」を採れば、日銀の国債保有の増大化、日銀のETF保有の増大化となる…。

※ 前者は、「実質上の、日銀の国債引き受けだ!」と言われ、後者は、「実質上の、日銀による日本株の買い入れだ!」と言われることになる…。

※ 事程左様に、世の中、「こちら立てれば、あちらが立たず。」だ…。

※ さらに残るは、「構造改革」だ…。

※ これとて、「デジタル革命!」「DXの推進だ!」と囃し立てたが、進捗はどんなものだったか…。

※ 「コロナ直撃!」にもかかわらず、せいぜいが「ハンコの廃止」くらいのものじゃないのか…。

※ それでも、「マイナカード」の取得割合は、80%くらいにはなってるようだが…。

『少し、話しにくそうだった。2月に来日した英国のトラス前首相にインタビューした時のことだ。最初は「自由な世界は中国からの深刻な挑戦に直面している」と対中政策を立て板に水のごとく話していた。

首相在任時の経済・財政運営から日本や世界が学ぶべき教訓は何か。話題を変えると天井をいったん見上げて言葉を選びながら答えた。「英国固有の状況に直面した。必ずしも他の国に当てはまるものではない」

トラス氏は今から半…

この記事は会員限定です。登録すると続きをお読みいただけます。』

『トラス氏は今から半年前、英国史上最短で首相の座から退いた。わずか49日、経済・財政運営を巡る混乱が原因だった。

保守党の党首選で経済成長を最優先に取り組む姿勢を繰り返してきた。就任後、大規模減税や規制緩和を組み合わせた経済政策を公表すると、英国債利回りが急上昇(債券価格は下落)した。財政赤字拡大への懸念から国債が売られたためだ。

英政府は所得税の最高税率引き下げの撤回を表明するなど事態の収拾に動いたが時すでに遅し。保守党内からも辞任論が噴出し退陣に追い込まれた。

トラス氏が言う「英国固有」の状況とは何か。

年金基金が国債などを担保にレバレッジ(てこ)をかける「ライアビリティー・ドリブン・インベストメント(LDI=債務主導投資)」という運用戦略をとっていたことだ。

金利が上昇し大きな損失を出し、取引相手方の金融機関からマージンコール(追加担保の差し入れ要求)を突きつけられた。支払いの現金を捻出するために国債などを売却せざるを得なくなり、売りの連鎖が発生した。

本当に英国だけの事情なのか。混乱のきっかけが財政規律の緩みを見透かされたことという点では日本も対岸の火事とはいえない。日本の国内総生産(GDP)と比べた債務残高の比率は英国よりはるかに大きい。

市場関係者は警鐘を鳴らす。「必ずしも日本ですぐ起きることではないが、市場が群集心理で反応することは常にありうる。財政規律のタガが外れている現状を修正し、財政赤字を減らす努力をしなければいけない」(りそなアセットマネジメントの黒瀬浩一氏)

驚いたのはトラス氏がこの年金基金の運用手法による市場の脆弱さを「知らなかった」と答えたことだ。財務省やイングランド銀行(中央銀行)との間で「明らかなコミュニケーションの問題があった」とも話した。

トラス氏は就任した直後に財務次官を解任したり、イングランド銀行の「役割を見直す」などと言及したりした。互いに不信感が広がっていた。

国のトップと中央銀行、財政当局との信頼関係なくして安定した経済運営は成り立たない。英国から学ぶ点はここにもある。

日本では植田和男氏が9日に新たな日銀総裁に就任し、翌日の10日にはさっそく岸田文雄首相の元を訪れた。鈴木俊一財務相も立ち会い協調を確認した。

インタビューの終盤、トラス氏が発した言葉が耳に残る。

「もし、もう一度時間があったら違った行動を取っていたかもしれない」

財政支出を拡大しつづけても日本では金利は急騰しないか。財政規律の緩みを放置すれば英国のような事態が起きうるのか。財政を巡る議論は国内でも百家争鳴だ。

ただ一つだけ言えることがある。経済・財政運営のやり直しはできない。英国から学ぶ最大の教訓だ。

【関連記事】

・史上最短首相のトラス氏、再始動 英財政の慣習に批判も

・トラスノミクスの失敗、「震源」は大減税よりもエネ対策

ニュースレター登録

多様な観点からニュースを考える

※掲載される投稿は投稿者個人の見解であり、日本経済新聞社の見解ではありません。

深川由起子のアバター

深川由起子

早稲田大学政治経済学術院 教授

コメントメニュー

分析・考察 (まだ)国際金融市場を擁する国の首相が年金運用の脆弱性を「知らなかった」と言えることを民主主義国家の強みとみるのか、脆弱さとみるのか、と言われれば今は後者が大でしょう。日本でも前政権下で財務省と官邸の関係に問題があったことは首相の回顧録が示すとおり。市場の群衆行動は不安になるとポジよりネガに激しく反応し、潜在的地政学リスクの相手から揺さぶりが来ることも考えられると思います。ばらまき懸念は常に存在するので、リスク情報の共有はしっかりやってもらわないと。

2023年4月17日 8:16いいね

37

中空麻奈のアバター

中空麻奈

BNPパリバ証券 グローバルマーケット統括本部 副会長

コメントメニュー

ひとこと解説 人の噂も75日とはよく言ったもので、トラス政権の失敗を他山の石にしようとする意識が薄れ、日本の財政は防衛、子ども、グリーンに向かい拡大が目される。財政規律を取り戻した上での支出ならまだしも、心配は尽きない。また、トラス政権での失敗の一つに、政府と中央銀行との間のコミュニケーションが指摘されると、日本の政府と日銀間のアコードの存在に意義が見出せるということなのかもしれない。金利が低い間に慣れてしまった財政の弛緩は大問題だと認識を改めたい。6月に向けてアメリカの債務上限問題の浮上を含め、過剰債務問題が中心のリスクになりえることに再度注意である。

2023年4月17日 10:10いいね

25

白井さゆりのアバター

白井さゆり

慶應義塾大学総合政策学部 教授

コメントメニュー

ひとこと解説 昨年9月末から10月初めにおきた英国の国債市場の不安定化は、年金基金の投資戦略にあった。問題は年金基金だけでなくファンドを含むノンバンクの存在が大きくなっておりかならずしも十分規制が適用されていないのに、投資実態が十分わかっていないことだ。銀行はリーマンショック以降金融規制が強化されているが、ノンバンクとの連関も高まっており危機が発生するとどのように銀行に波及するかも十分わかっていない。このような認識があるにもかかわらず、世界の金融当局はまだ十分対応しきれていない。英国ではイングランド銀行の介入で混乱が収まった。3月の米国の地域銀行の破綻も原因は異なるが、金利上昇に関連するものだった。

2023年4月17日 8:15いいね

18

永浜利広のアバター

永浜利広

第一生命経済研究所 首席エコノミスト

コメントメニュー

ひとこと解説 当時の英国では、インフレ率が既に+10%台に到達しており、需給ひっ迫によりインフレ率が目標の+2%を大きく超えてしまっていました。

実際、IMFのGDPギャップで比較すると、英国では2022年時点で需要超過になっており、需要超過によりインフレ率が加速していました。

さらに、各国国債の信認を左右するとされる4指標についてG7で比較しても、英国は政府純債務/GDPと政府債務対外債務比率はG7中3番目に低かったものの、基軸通貨国米国に次ぐ経常赤字/GDPが大きい国である上、米国とフランスに次ぐ対外純債務/GDPが高いことからすれば、財政出動は限界だったと言えるでしょう。

2023年4月17日 8:13 』

紙幣を受託製造している最大手が経営難に。

http://blog.livedoor.jp/goldentail/archives/31305631.html

『印刷技術が向上している今、偽札を作るのが難しい紙幣を作るのは、どこの国でもできる仕事ではありません。自前で、そういう技術を持たない国は、技術のある国へ紙幣の製造を発注します。日本の場合、人間国宝並の加工技術を持つ技師が、原版を作るので、偽札造りのメッカである北朝鮮でも、完全にはコピーできず、偽札を摘発されています。その分野で、世界最大の規模を持つのが、イギリスのデ・ラ・ルー社です。今、この会社の株が下落していて、最盛期の1/5になっています。

この会社の受け持つ紙幣は、世界150カ国に達していて、自前の造幣局を持たない国の殆どをカバーしています。この原因なのですが、それだけ貨幣の電子決済が進んで、紙幣の需要が落ちているという事があげられます。何も、仮想通貨の例を挙げる事もなく、日本も含めて、貨幣の電子化を推進する国が、増えています。これは、プリペイド・カードやデビッド・カード、クレジット・カードなどの電子決済も含みます。貨幣を電子化すると、殆ど野放し状態になっている商行為が記録として残る為、税金の徴収が自己申告ではなく、客観的なデータに基いて可能になるという利点があります。それと、十分に電子化が進むと、紙幣発行という、物凄く莫大な経費がかかる作業をする必要が無くなります。

紙幣や貨幣の発行というのは、めちゃくちゃ金のかかる作業で、しかも流通の管理もしないといけません。つまり、銀行などの金融機関を通じて、古い紙幣や貨幣は、集めて確実に破棄して、新しいものと交換する必要があるのですね。実に面倒です。こうした事にかかる費用というのは、馬鹿にならない金額になるので、国にとって通貨の発行というのは、金ばかりかかる、やっかいな作業なのです。

フィンテック企業など、新たなサービスと結びついた、従来の金融機関とは異なるネット系の金融サービスは、電子決済を取り入れる事で、とても便利である為、発展途上国も含めて、紙幣の需要というのは、右肩下がりで減っています。これが、デ・ラ・ルー社の株価が下落している原因です。つまり、望む望まないに関わらず、紙幣というものの役割が減っているのです。この辺りを狙って、ドイツで先進企業として展開していたワイヤーカード社のドイツ金融史上最大の不祥事と言われた不正会計問題を扱ったYoutube動画を作成中です。Part1は公開済みですので、よかったら、前記事のリンクからどうぞ。

この問題、かなり深刻で、顧客である国からすると、自国の紙幣の製造を依頼しているのですから、経営が悪化して潰れたりしたら、即、通貨の発行が行き詰まる事になります。切り替えると言っても、特殊印刷という極秘技術の塊みたいな分野ですから、簡単に他所の会社に依頼できません。電力という資源が、どの国でも足りなくなってきているので、全面的に電子化すれば、安心という問題でも無く、単にアナログからデジタルへの切り替えの過度期と片付けてしまえる問題でもありません。停電したら、使えませんでは、通貨は済まないからです。この問題、かなりセンシティブで、簡単には解決しない問題です。

そして、以下に通貨の発行というのが、いかに国にとって負担かという事を、この会社の母国であるイギリスの財政事情が示しています。イギリスは、先日、エリザベス女王が逝去され、チャールズ皇太子が国王に就任したので、当然ながら紙幣のデザインが変わります。今は、エリザベス女王が紙幣に印刷されていますが、これがチャールズ国王になるわけですね。ところが、新紙幣の発行は予定されているのですが、現在流通している紙幣を交換するとなると、その費用が捻出できず、今の紙幣も当分の間は、平行して利用できるように決めました。チャールズ国王の印刷された紙幣は、流通量が著しく減った時の補填か、極めて限定された量しか発行されない事が、既に決まっています。

イギリスは、国の規模に合わない手厚い福祉と社会保障で、国家財政がボロボロでして、しかも経済の調子もEUを離脱した影響で良くありません。特に、ポンドが国際決済通貨である事から、欧州の金融の中心はロンドンのシティーであり、絶対的な影響力を持っていたのですが、EU離脱で資金の流通に手続きや費用がかかるようになった事で、欧州各国に分散し始めています。既に、その座の切り崩しは、かなり急テンポで進んでいて、虎視眈々と金融センターの座を奪うべく狙われています。

今のイギリス経済は、四面楚歌状態な上、思想的に強迫観念でも持っているのかと思うくらい、CO2排出規制に振れて、石炭火力発電所を廃して、風力発電などの自然エネルギーへ転換した為、恒常的に電力不足な上、電力料金がバカ高くなっています。今年の冬は、電気代が家賃と同額になるくらい、料金の負担が増えました。それでも、電力会社は赤字だったりします。つまり、国を運営する費用が割高な上、権利ばかり見て持続性を検証しない高度な福祉行政で、常に金が無い状態が、今のイギリスという国家です。欧州に散らばっている難民が、最終的にイギリスを目指すのも、何も持っていなくても、最低限の生活が保証されるからです。もちろん、費用は、全てイギリス政府の持ち出しです。

高度な福祉行政と言っても、先日の記事で書いたように、救急車の出動回数を減らす為に、救急車要請の電話が入ると、担当医が病状を聞いて、緊急性が無いと判断すると、断るなんて事をしています。つまり、制度として高度な医療体制は維持されているのですが、金が無いから適用するのに制限をかけているのです。また、こうした緊急性を要さない患者というのは、診察まで待機状態にさせられるのですが、これが常に十万人単位で詰まっている状態で、いつ医療を受けられるのか、患者が判らない状態になっています。ただし、制度としては、確かに欧州でも最も手厚い医療制度になっています。機能していないだけで。実際、素人の患者が、うまく病状を電話で説明できるはずもなく、救急搬送を断わられて、自宅で病死した人も出ています。制度だけ見て、素晴らしいなんて言っているのは、実に愚かだという事が判ります。運用まで含めて見ないと、法律なんていうのは、魂の入ってない仏みたいなものです。条文では、いくらでも良い事が書けますからね。実行が伴ってこその法律です。

なんで、何か国内で問題が発生すると、欧州に外遊しに行って、「欧州は素晴らしい。それに較べて日本は・・・」とか言ってる政治家は、それだけで信用に足りません。恐らく、上っ面しか見てないからです。議論上での「あるべき論」とか、現実社会では、クソの役にも立たない事が多いのです。結局、イギリスは廃止する予定の原子力発電所の運転を継続し、更に新設する計画まで復活させざるを得なくなりした。もちろん、抜け目なく、原発をクリーンエネルギーに含めるという操作を先にやっています。クリーンエネルギーなら、頼っても良いという、実に都合の良い論理です。

私は、EVも行き詰まった時点で、これをやってくると見ています。欧州の掌返しは、今に始まった事ではなく、180度逆の事を平気で言い始めます。そもそも、EVの前は、「ディーゼル・エンジンこそ、環境問題の答えだ」とか言ってましたからね。そして、フォルクスワーゲンのCO2排出データ捏造事件ですよ。旗色が悪くなると、あっさり捨てて、EVに切り替えましたね。なので、基本的に信用しちゃいかんのです。そういう地域だと思って付き合わないと、振り回されて終わりです。』

フィンランド 世界最大級の新型原発 営業運転へ

https://www3.nhk.or.jp/news/html/20230315/k10014009171000.html

『2023年3月15日 19時04分

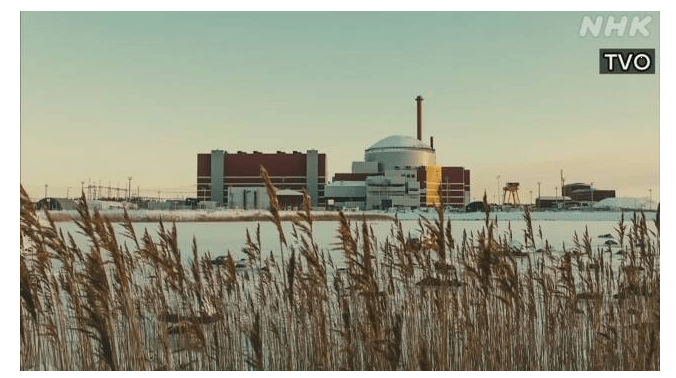

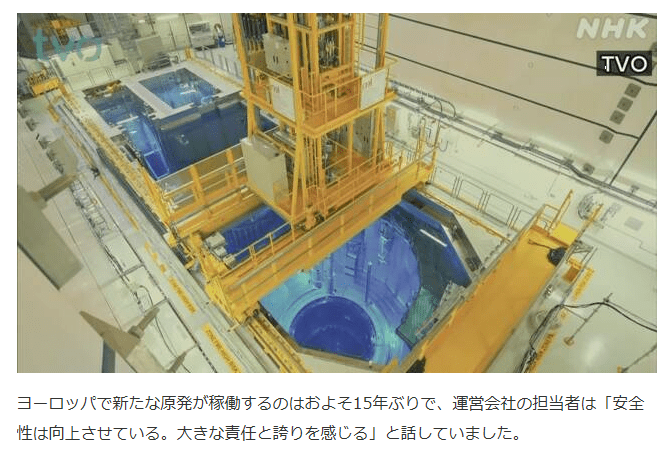

ウクライナ情勢などを受けて原発を活用しようとする動きがヨーロッパで広がる中、世界最大級の新型の原発が来月、フィンランドで営業運転を始めるのを前に、その内部がメディアに公開されました。ヨーロッパで新たな原発が稼働するのはおよそ15年ぶりとなります。

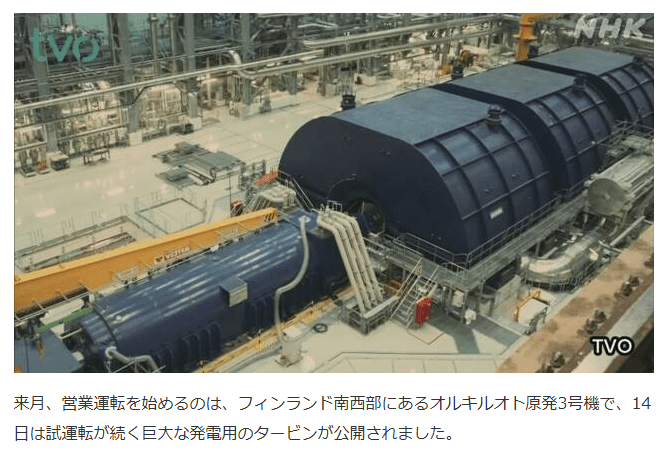

来月、営業運転を始めるのは、フィンランド南西部にあるオルキルオト原発3号機で、14日は試運転が続く巨大な発電用のタービンが公開されました。

3号機はフランス企業などが手がける、ヨーロッパ加圧水型原子炉と呼ばれる新型炉です。

最大出力は160万キロワットと世界最大級で、フィンランドの電力需要の14%を担えるということです。

独立した4つの緊急冷却装置や、溶け落ちた核燃料を冷却する「コアキャッチャー」と呼ばれる設備など、最新の安全対策が取られているとしています。

この原発は2005年に建設を始めたあと、原子炉の基幹部品に不具合が見つかるなどトラブルが相次ぎ、2009年に予定していた運転開始が10年以上遅れていて、地元メディアによりますと、建設費は110億ユーロ以上と、当初の見積もりの3倍以上に膨れあがっているということです。

ヨーロッパで新たな原発が稼働するのはおよそ15年ぶりで、運営会社の担当者は「安全性は向上させている。大きな責任と誇りを感じる」と話していました。

ヨーロッパでは、フランスが新たに6基の原発を建設する方針を打ち出しているほか、イギリスやポーランドなども複数の原発の建設を計画するなど、ウクライナ情勢などを受けて、原発を活用しようとする動きが広がっていますが、原発の安全性の確保に加えて建設期間の長期化やコストの増大などのリスクが課題となっています。』

欧州最大級原発新たに稼働 フィンランド、40年ぶり

https://www.shinmai.co.jp/news/article/CNTS2023041600680

『【ロンドン共同】フィンランド南西部のオルキルオト原発で16日、欧州最大級となる3号機(出力160万キロワット)が本格稼働した。原発の運営会社が発表した。ロシアのウクライナ侵攻の影響でロシアからの電力やガスの供給が停止する中、エネルギー供給の安定化と価格高騰への対策となることが期待される。

国際原子力機関(IAEA)によると、フィンランドで新たに原発が本格稼働するのは40年以上ぶり。

原発稼働を巡りドイツが事故リスクや放射性廃棄物問題を重視して原発利用を終了したのに対し、英国やスウェーデンでは新たな建設計画が進んでおり、欧州でも対応が分かれている。』

ウクライナ戦争で幕を閉じた「平和の配当」の時代

https://wedge.ismedia.jp/articles/-/29976

『3月6日付の英フィナンシャル・タイムズ紙は、「平和の配当の終焉」(The end of the peace dividend)との社説を掲げ、ロシアのウクライナ戦争と中国の敵対行為により西側民主主義国は再度軍備拡充に舵を切ったが、今後福祉など、他の分野への資金配分との困難なトレードオフが発生すると指摘している。要旨は以下の通り。

冷戦終結後の四半世紀、西側民主主義国は、世界的対立は終わったと信じてきた。過去の防衛費の一部は学校や病院に回った。だがロシアのウクライナ侵攻と中国の敵対行動で、「平和の配当」は確実に終わりを告げた。米英豪が安全保障の枠組み「AUKUS(オーカス)」の元で原潜の太平洋配備を発表し、英国が仏、独ほかに続き国防費増額を決めたのは今月(3月)だ。民主主義国は、戦争に備えることで国境の平和を保てると期待してきた。

西側政府が認識しつつある通り、兵器技術進歩で近代戦のコストは大きく増大した。更にウクライナ戦争は、21世紀の紛争は全てが遠隔地からのサイバー攻撃やドローン、精密爆弾による訳ではなく、これまでと同様に戦車や砲撃、地上部隊が意味を持つことを示した。全ての脅威に万全の準備をするには、全てのツールと産業基盤が必要だ。従って、民主主義国は冷戦時代に比べ、技術、情報、負担、調達のより幅広く深い共有が必要になる。

AUKUSはそのような原則を実施に移す意欲的な試みだ。3カ国は潜水艦のみならず極超音速ミサイル、AI、量子コンピューターでも協力する約束だ。豪英は新攻撃型潜水艦を共同生産する。豪州の資金が英国造船所の能力拡充を助け、共同調達でコストが下がる。

また、2つの別の三カ国連合(注:日英伊、仏独スペイン)が次世代戦闘機について協力している。欧州連合(EU)でさえ新たな試みを始めた。EUは弾薬共同発注のために10億ユーロを支出し、既存の在庫からウクライナに弾薬を供給する加盟国に対し10億ユーロを補填することに合意した。

その先には困難なトレードオフが控えている。1980年代後半以降公的支出に占める国防費比率が下がってきた結果、欧州諸国は税負担の大幅な増大なく福祉システム拡充ができた。西側政府は新たな軍拡が何を意味するかにつき未だ国民に説明を始めてさえいない。

また、抑止のための再軍備のリスクは、相手がそれを挑発と捉えることだ。冷戦期には2超大国の直接紛争は最終的には回避された。今日の複雑な地政学的状況は、この再演を相当難しくしている。

* * *

ウクライナ戦争や中国の台頭に呼応した西側陣営の国防費増加が、福祉、教育など他の分野での政府支出に影響を与えることを「平和の配当(平和の結果国防費以外に支出を振り向けられた)の終焉」という言葉で説明した、ある意味当然だが、従来あまり見たことのない視点を提供する社説である。

第一に、紛争に対する最大限の準備をすることが、紛争の発生自体を抑止するための最善の道であるという「抑止」の基本的前提は間違っていない。冷戦終結以降の西側における国防に対する投資の落ち込み・停滞が、今日の事態を招いた一因であろう。

そもそも米国の国防費がNATO加盟国の国防支出総額の約7割を占めるという状況は、防衛上の問題以前に米国の国内政治上持続可能ではなく、トランプ前政権はそのことをこれ以上ないほど直接的な形で指摘したのだが、欧州の対応は緩慢だった。その米国でさえ、国防費は2010年以降減少傾向で、2015年に2010年比で15%近く減少し底を打った後増加に転じたが、ようやく2020年に2010年のレベルを超えた(+5%)に過ぎない。』

『それでもまだ米国の国防支出は世界全体の国防費の40%を占める膨大な額であるが、バイデン政権はこれまでインフレ率を下回る国防予算しか提案しておらず、それを増額しているのは議会側だというのも、若干気になる話だ。そして、欧州と日本の国防費支出を巡る基本的対応を変えるには、残念ながらウクライナ戦争のような危機が必要だったというのが現実である。

「抑止のための再軍備のリスクは、相手がそれを挑発と捉えることだ」という指摘があるが、軍拡を続けてきたのは相手方であり、それに対応することを更なる軍拡の口実にするのは筋違いだ。上記の通り2010~20年に米国防費がほとんど増加せず、支出累計の伸びが鈍化していた一方、中国の国防費の伸びは驚異的で、同じ2010~20年の間に2.4倍になっている。これは、年平均17%以上の伸びである。

求められる国民への説明

第二に、この社説の主題である、国防費増が福祉・教育などの他の支出に与える影響であるが、「西側政府は新たな軍拡が何を意味するかにつきまだ国民に説明を始めてさえいない」というのは重要な指摘である。ということは、昨年来の岸田政権による防衛費増額の原資に関する議論は、増税議論の不人気を承知の上で政府としてあるべき正直な問題提起を行ったものとして高く評価されるべきだろう。

詳細は今後の議論が必要だが、将来に向けた基盤的支出である防衛費を国債発行という借金ではなく、経費削減と最低限に必要な増税で賄うと言う大枠が既に決まっていることの意味は大きい。

最後に、国防費増はようやく始まったが、抑止すべき「対象」において未だ「空白」がある。最近になって報道されるようになったが、アフリカに対する中国の進出はここ数年で始まった話ではなく、対応ぶりも過去の失敗から学びながら日々進化している。

ロシアの進出はまだ一部に限られているが、中央アフリカなどにおける歴史は長い。「裏庭」に責任を持つという考え方から言えば、日本が東南アジアの平和と繁栄に対して継続的に努力し一定の成果を上げてきたことに比べ、欧州全体としてのアフリカへの関与は大いに不十分だ。ウクライナ戦争を奇貨として、この空白に対して欧州が対応することが望まれる。』

中国、生成AIに審査義務 「国家分裂の扇動」など禁止

https://www.nikkei.com/article/DGXZQOGM116QU0R10C23A4000000/

※ どこまで行っても、「人間らしく、自分の頭で、ものを考える力」が、「鍵(かぎ)」となる…。

『2023年4月11日 17:19

【北京=多部田俊輔】中国政府は11日、精緻な文章や画像などを作り出す生成AI(人工知能)の規制案を発表した。社会主義体制の転覆や国家の分裂などを扇動する内容を禁止し、当局による事前審査を義務付ける。生成AIを含めてネット世論の統制を強化する。

中国でネットを統制する国家インターネット情報弁公室が同日、全21条で構成する「生成型AIサービス管理弁法案」を公表した。5月10日まで専門家らの意見を聴取…

この記事は会員限定です。登録すると続きをお読みいただけます。』

『5月10日まで専門家らの意見を聴取し、年末までの実施を見込む。

規制案は第1条でインターネット安全法(サイバーセキュリティー法)、データ安全法(データセキュリティー法)、個人情報保護法に基づき、生成AIの健全な成長を目的とすると明記した。第2条でアルゴリズム(計算手法)やモデルなどに基づいて生成された文章、画像、音声、動画などを規制対象とした。

第4条で生成AIのサービスは法律、法規を順守し、習近平(シー・ジンピン)指導部が示す社会主義核心価値観を体現しなければならないと規定した。政権や社会主義体制の転覆、国家分裂の扇動、国家統一を損なう内容、テロリズムの宣伝、暴力、わいせつ、虚偽情報などを含む内容を禁止した。

中国共産党と習指導部による統治や、台湾統一に向けた動きに対する批判を排除する狙いがあるとみられる。

消費者へのサービス提供前にネット当局のセキュリティー審査を受けることも義務付けた。当局はネット検索サービスなどに事前審査を求めており、生成AIも対象に加える。

中国は「ChatGPT(チャットGPT)」など米国の生成AIの国内利用を厳しく規制している。当局の指導の下で百度(バイドゥ)やアリババ集団などが独自の生成AIの開発に取り組む。

生成AIをめぐってはデータの不正収集や差別、偽情報の助長、サイバー攻撃への悪用といった懸念も出ている。イタリアが利用を一時禁止するなど、個人データ保護法制が厳しい欧州を中心に規制強化が進む可能性がある。米国でも非営利団体などがAI開発の危険性を指摘して規制を訴えている。

【関連記事】

・高度なAIの開発中断、マスク氏ら要求 慎重論の背景は?

・ChatGPTは「人類の危機」か AI開発停止運動で波紋

・[FT]ChatGPTの背中を追う中国テック大手

ニュースレター登録

多様な観点からニュースを考える

※掲載される投稿は投稿者個人の見解であり、日本経済新聞社の見解ではありません。

楠正憲のアバター

楠正憲

デジタル庁統括官 デジタル社会共通機能担当

コメントメニュー

ひとこと解説 LLMの開発において、たくさんの利用者に使ってもらって、そのフィードバックで強化学習を行うプロセスは重要だ。表現の自由が認められている西側諸国にとって、中国がLLMを使ったサービス提供を厳しく規制することは、開発競争を優位に進める機会となり得る。一方で子どもによる利用でトラブルが生じたり、LLMを悪用した事件が起きた場合、もっと厳しく規制すべきとの議論が起こるのも時間の問題だ。対話型AIの悪用や国家による統制といった負の側面からも目を背けずに、社会としての向かい合い方を考えて、様々な立場からオープンな対話を積み重ね、国際的なルールの形成に貢献していく必要があるのではないか。

2023年4月11日 20:26いいね

16

佐藤一郎のアバター

佐藤一郎

国立情報学研究所 教授

コメントメニュー

ひとこと解説 一般論だが、対話型AIは、国家による言論操作にとっても強力なツールとなりうる。

というのは①学習・生成アルゴリズムの調整、学習対象のデータを限定したり、特定の質問を制限することで、容易に結果を偏らせることもできる。②利用者が対話型AIの結果に満足すればその結果の元情報を見なくなるからだ。つまり、国家の都合のいい情報空間に人々を閉じ込めることができる。さらにそうした偏った対話型AIを他国に輸出することは、その他国の世論を操作できることになる。

対話型AIを画期的な技術だとして、その効用を議論するのも結構だが、そろそろ対話型AIの負の影響を議論すべき時期に来ているのではないか。

2023年4月11日 19:12 (2023年4月11日 19:29更新)

いいね

40

浅川直輝のアバター

浅川直輝

日経BP 「日経コンピュータ」編集長

コメントメニュー

ひとこと解説 中国が求める対話AIを開発するには、対話AIが出力するテキストが「体制の転覆」「国家分裂の扇動」などに相当する否かを判定するAIモデルを新たにつくり、強化学習などを通じて対話AIの出力に一定の制約を設ける必要がありそうです。

ただChatGPTが自ら証明したように、ユーザーが質問文(プロンプト)を工夫することでこうした制約を外す「脱獄」も原理的には可能です。脱獄を試みるユーザーが増え、続いて中国が脱獄用のプロンプトを規制し・・・といったいたちごっこになる可能性があります。

2023年4月11日 21:08 』

米印空軍演習参加にB-1爆撃機がインド再展開:東京の郊外より・・・:SSブログ

https://holyland.blog.ss-blog.jp/2023-04-14-1

『 「Cope India 2023」演習が4月10-24日の間で

米空軍はF-15EとC-130Jも参加、B-1は2月にも

航空自衛隊員もオブザーバ参加

COPE INDIA2.jpg4月13日付米空軍協会web記事が、インド国防省による米印空軍演習「Cope India 2023」に関する12日付プレスリリースなどを紹介しつつ、今年2月に開催のインド航空ショー(Aero India)に続き、B-1爆撃機がインドに展開するなど、米軍とインド軍との関係が強化されつつある様子を伝えています

なおインド国防省発表はわずか6行の短いものですが、最後に「航空自衛隊員がオブザーバー参加し、米印空軍と交流する(Personnel from the Japanese Air Self Defence Force will also observe the exercise and interact with the two participating air forces)」と記されており、アジア・インド太平洋地域において日本に期待される役割が急速に拡大していることを伺わせます

COPE INDIA5.jpg訓練は、4月10日から開始の第1フェーズ「空輸フェーズ」で始まり、横田基地C-130やハワイヒッカム基地のC-17による空輸訓練が行われ、この間にWilsbach太平洋空軍司令官がインド空軍のロシア製SU-30MKI後席に搭乗して飛行する画像が公開されるなど、両国空軍の親密ぶりをアピールする場面が今後も発信されていくものと考えられます

13日から始まった第2フェーズは「航空作戦フェーズ」で、米空軍からはF-15EストライクイーグルにB-1爆撃機、インド空軍はSu-30 MKI, Rafale, Tejas, Jaguar戦闘機、更にインド空軍の空中給油機やAWACSも投入して、24日まで訓練することになっています

COPE INDIA3.jpg米印空軍演習「Cope India」は2004年に初回が実施され、その後2005, 2006, 2009年に実施されていますが、その後は2018年の再開まで間隔が空いており、米印関係のバロメータのような演習となっています。

その他、隔年開催のインド航空ショー(Aero India)の視点で見てみると、2021年開催の同イベントにB-1がインド初展開参加して大きな話題になりましたが、2023年2月開催時にはB-1が大サービスで超音速飛行を行ったほか、F-35の性能展示飛行や三沢F-16デモ飛行チームによるアクロバット飛行なども披露され、会場を大いに盛り上げ、インドメディアで大きく取り上げられたとのことです

///////////////////////////////

COPE INDIA4.jpgフィリピンでは米軍17000名が参加する大規模演習「Balikatan」が始まり、豪州では7月に米豪演習「Talisman Sabre」が兵站に特化して過去最大の兵站演習として計画されるなど、不動産バブル崩壊で弱みも見せつつある中国に、「対中国」包囲網構築を見せつけるかのような、米軍とアジア太平洋地域諸国との訓練が花盛りであり、誠に素晴らしいことです

インド国防省プレスリリース12日付

→ https://pib.gov.in/PressReleaseIframePage.aspx?PRID=1915928

2021年のB-1爆撃機インド初展開

「米軍爆撃機が75年ぶりインド訪問」→https://holylandtokyo.com/2021/02/10/259/

応援お願いします!ブログ「東京の郊外より」支援の会

→https://community.camp-fire.jp/projects/view/258997

ブログサポーターご紹介ページ

→https://holylandtokyo.com/2020/04/15/727/

タグ:Cope India Aero India インド 米空軍 太平洋空軍司令官 B-1 SU-30MKI F-15E C-130J

2023-04-17 05:00 nice!(2) コメント(0)

共通テーマ:ニュース

nice! 2

@ミック

@ミック

鉄腕原子

鉄腕原子

コメント 0

コメントを書く

お名前:[必須]

URL:[必須]

コメント:

| RSS2.0 』

リーク文書でわかったこと。米軍が抱いている、台湾防衛上の懸念は、…。

https://st2019.site/?p=21058

『Ellen Nakashima, Christian Shepherd and Cate Cadell 記者による2023-4-15記事「Taiwan highly vulnerable to Chinese air attack, leaked documents show」。

リーク文書でわかったこと。米軍が抱いている、台湾防衛上の懸念は、開戦第一撃の大量のミサイル奇襲から、台湾空軍機が守られるかどうか。山腹トンネルのシェルターはあるのだが、そこに軍用機を引き入れる前に敵のミサイルが降って来たらおしまいだから。その一斉引き込み作業が、果たしてちゃんとできるのかどうか。

飛来する1発のミサイルにつき、2発ずつのSAMを発射するという従来の方針も、逆にこっちが弱るだけだから、考え直す必要がある。

台湾空軍機は、地上で動かない標的を攻撃する訓練をしているが、中共はSSMの発射プラットフォームをますます機動式にしているから、その訓練ではダメだ。

台湾政府のミサイル空襲避難訓練は、筋書きがすべて決まっている学芸会の劇でしかなく、民間防衛部門の政府役人に対する非常時対応訓練に、ほとんどなっていない。

中共本土には、台湾を攻撃するための空軍基地が40箇所近くあり、そこに付属する航空機シェルターは800以上。これが、台湾本島から600マイル以内に集中しているのである。』